I.A. et psychologie

Introduction

Pour intégrer des contenus liés à l'IA dans un cours de psychologie, en particulier ceux qui couvrent la psychopathologie (traitement, diagnostic), deux modules sont présentés dans ce portfolio. Des lectures peuvent être attribuées à partir de la liste de références fournie à la fin.

Le contenu relatif à l'IA en psychologie se concentre, en partie, sur l'utilisation d'algorithmes et d'applications basés sur l'IA pour la recherche psychologique et la détection de maladies à l'aide de données cliniques accessibles au public. L'IA peut être utilisée pour l'analyse des données épidémiologiques, y compris les données des médias sociaux, pour comprendre les conditions de santé mentale, pour la détection des maladies et pour l'estimation du risque de maladie mentale. Ceci se réfère au contenu du module 1.

Une autre façon dont l'IA et la psychologie se croisent est l'utilisation de la thérapie assistée par l'IA, que ce soit seule ou en complément d'un traitement dirigé par un thérapeute (humain). Il peut s'agir de thérapies cognitivo-comportementales basées sur Internet, d'applications de pleine conscience et de bien-être, de compagnons artificiels, d'applications de réalité virtuelle (RV), de jeux informatiques thérapeutiques et d'agents conversationnels (chatbots). Cela renvoie au contenu du module 2.

Module 1 - L'IA et la santé mentale : Recherche et détection

La détection des maladies mentales à l'aide des données des médias sociaux et du comportement en ligne se situe à l'intersection de la linguistique informatique et de la psychologie clinique. L'utilisation de l'IA et de l'apprentissage automatique à partir des données recueillies auprès des utilisateurs des médias sociaux a accéléré la création d'outils prédictifs qui peuvent être utilisés pour évaluer le risque de développer ou de détecter la présence de troubles mentaux. Les chercheurs se sont principalement concentrés sur les troubles mentaux suivants : troubles de l'humeur, troubles alimentaires, schizophrénie et psychose, et idées suicidaires (Chancellor & Choudhury, 2020).

Des études récentes ont analysé des données d'utilisateurs accessibles au public sur des plateformes de médias sociaux, telles que Twitter (Amir et al., 2019 ; Joshi & Patwardhan, 2020 ; Wang et al., 2021) et Reddit (Jiang et al., 2021 ; Uban et al., 2021), afin de vérifier si l'IA peut prédire le risque de développer un trouble de santé mentale, ou détecter la présence d'un tel trouble. Le consensus est que oui, les données peuvent révéler un risque pour la santé mentale.

Toutefois, la précision, la fiabilité et la validité de ces méthodes ont suscité des préoccupations d'ordre éthique (Orr et al., 2022). En outre, d'autres questions se posent : quels sont les risques/bénéfices ? Quelles sont les implications à court terme et à long terme ? La détection des maladies facilite-t-elle l'accès aux interventions ou aux soins de santé mentale en temps opportun ? Comment les utilisateurs des médias sociaux devraient-ils être informés (si tant est qu'ils le soient) du risque qu'ils courent ?

Un répertoire libre d'ensembles de données destiné à faciliter la recherche dans ce domaine a été compilé et mis à disposition par Harrigian et al. (2021), ainsi qu'un ensemble de données composé de mots-clés relatifs à la santé mentale utilisés dans les tweets sur Twitter (Harrigian, 2020). Les liens vers ces documents sont fournis à la fin de ce dossier.

Étant donné que l'utilisation des médias sociaux et la présence active en ligne font partie intégrante de la culture contemporaine, on peut s'attendre à ce que de nombreux étudiants utilisent plusieurs de ces plateformes. Ce sujet se prête donc bien à des discussions en classe, à des auto-réflexions, ainsi qu'à des projets/essais pour les étudiants inscrits à un cours de psychologie.

Module 2 - IA et santé mentale : Traitement

En 2020, une grande partie du monde a été fermée en réponse à la pandémie de Covid-19. Cette situation a inévitablement entraîné un changement dans la manière dont les gens reçoivent des soins de santé mentale : pendant que les restrictions étaient en place, la télémédecine synchrone a remplacé le traitement en personne. Bien que le passage à la fourniture et à la réception de traitements en ligne ait permis d'éviter des interruptions de traitement majeures, il n'en reste pas moins que le système de soins de santé mentale de nombreux pays est surchargé, manque de personnel et n'est pas accessible à tous ceux qui ont besoin de soins (Johnson et al., 2021). En outre, la demande de soins de santé mentale a augmenté de manière exponentielle pendant la pandémie (Aknin et al., 2022 ; Singu, 2022), et il est clair que le système doit être amélioré (Aknin et al., 2022 ; Moreno et al., 2020). La solution réside peut-être dans l'IA ?

Le recours aux thérapies synchrones et asynchrones assistées par l'IA (réalité virtuelle (RV), réalité mixte (RM), réalité augmentée (RA), chatbots, applications, etc.) était utilisé bien avant la pandémie, mais depuis 2020, l'utilisation des thérapies assistées par l'IA s'est considérablement accrue (Carlbring et al., 2023).

La psychothérapie synchronisée assistée par l'IA à l'aide de la RV ou de la RM/AR est souvent utilisée pour traiter les troubles anxieux, les phobies, le stress et les troubles de stress post-traumatique, les troubles de l'alimentation, la rééducation neurologique, la gestion de la douleur, voire la psychose (Ma et al,. 2021). Elle peut également être utilisée pour développer l'empathie (Shashkevich, 2018). Cependant, ses forces sont aussi ses faiblesses : Ma et al. (2021) soulignent que l'efficacité de la RV/MR/AR peut être diminuée parce que les patients savent que la situation n'est pas "réelle" ; à l'inverse, certains patients peuvent se sentir plus en sécurité lorsqu'ils ne sont pas exposés à des scénarios réalistes qui causent normalement leur détresse. En résumé, cette forme de thérapie assistée par l'IA est encore en développement et a besoin d'être normalisée, et l'accès au traitement peut encore constituer un obstacle.

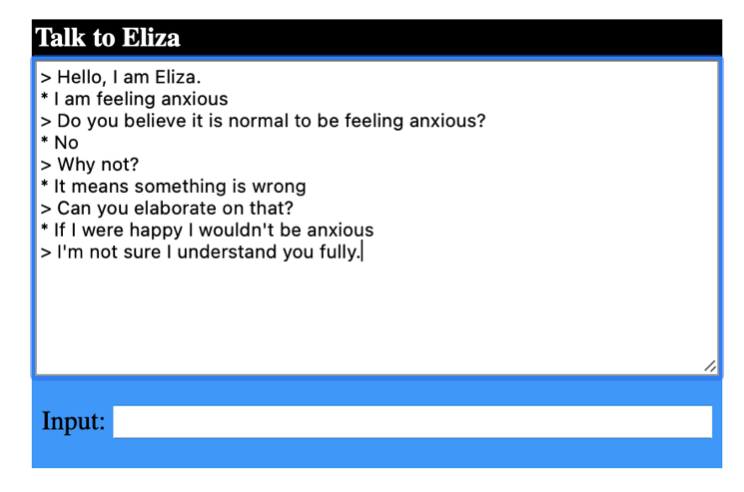

La thérapie asynchrone assistée par l'IA pourrait constituer une solution pour surmonter les obstacles à l'accessibilité. En fait, les chatbots de santé mentale, ou thérapeutes par chat, existent depuis les années 1960. Le plus célèbre d'entre eux - ELIZA(http://psych.fullerton.edu/mbirnbaum/psych101/eliza.htm)- a été développé pour générer des réponses semblables à celles des humains à des entrées en langage naturel dans un cadre psychothérapeutique (Weizenbaum, 1966). Les chatbots s'appuient sur la reconnaissance de scripts ou de modèles de langage pour générer des réponses (Coheur, 2020), mais peuvent-ils imiter les humains de manière fiable et paraître intelligents ? En d'autres termes, peuvent-ils passer le test de Turing (Oppy & Dowe, 2021) ?

Les chercheurs ont constaté qu'en général, les patients ont une opinion favorable des thérapeutes par chat, mais que les scripts des chatbots doivent encore être affinés pour pouvoir offrir des soins personnalisés au même niveau qu'un psychothérapeute humain (Abd-Alrazaq et al., 2021). Bien que les patients reconnaissent que les chat-thérapeutes ne sont pas des êtres humains, ils peuvent tout de même leur faire confiance (Bram, 2022 ; Darcy et al., 2021), et la confiance est essentielle pour l'efficacité de la psychothérapie en personne (Li et al., 2021).

La société à l'origine de l'application WoeBot(https://woebothealth.com/) affirme que sa marque de psychothérapie assistée par l'IA vaut l'argent des patients car elle est : 1) gratuite, 2) disponible 24 heures sur 24 et 7 jours sur 7, et 3) accessible sans recommandation ni prescription. Cependant, certaines données sur les utilisateurs sont collectées (comme indiqué dans leur politique de confidentialité). Les implications éthiques de cette pratique doivent être prises en compte : en bref, la fin justifie-t-elle les moyens ?

Les études épidémiologiques estiment que jusqu'à 50 % des personnes recevront un traitement pour un trouble de santé mentale à un moment donné de leur vie (Kessler et al., 1994, cité dans Pedersen et al., 2014), ce qui fait de la thérapie assistée par l'IA un sujet pertinent et pertinent pour les étudiants inscrits à un cours de psychologie, compte tenu de l'état actuel du système de soins de santé mentale.

Travail de cours - Option 1 : discussion en classe

L'instructeur prépare une discussion en classe, qui peut inclure l'utilisation de l'un des messages ou questions suivants.

La discussion du module 1 peut porter sur les points suivants

- Quels sont les risques liés à l'utilisation de l'IA dans la détection des maladies ?

- Quels sont les avantages de l'utilisation de l'IA dans la détection des maladies ?

- Qu'est-ce qui fait d'un outil un bon outil de détection ou d'évaluation du risque de maladie ?

- Peut-on se fier à ces méthodes de détection pour évaluer de manière précise et fiable la présence ou le risque d'une maladie ?

- Comment améliorer ces méthodes de détection ?

La discussion du module 2 peut inclure

- Quels sont les risques liés à l'utilisation de la psychothérapie assistée par l'IA ?

- Quels sont les avantages de la psychothérapie assistée par l'IA ?

- Qu'est-ce qui fait un bon outil de psychothérapie assistée par l'IA pour traiter les maladies ?

- Peut-on compter sur ces psychothérapies assistées par l'IA pour traiter les maladies de manière précise et fiable ?

- Comment améliorer ces psychothérapies assistées par l'IA ?

Travail de cours - Option 2 : Réflexion personnelle

Les étudiants peuvent choisir ou se voir attribuer une question du module concerné et rédiger une réflexion personnelle.

Exemple d'auto-réflexion du module 1:

- En repensant à votre utilisation des médias sociaux, vous sentiriez-vous à l'aise si un chercheur utilisait vos données pour former un outil d'IA de détection de la santé mentale ?

- Votre réponse changerait-elle si vous acceptiez de participer à une étude de recherche ?

- Pensez-vous que ce type de recherche permettra d'améliorer le traitement des maladies mentales ?

Exemple d'autoréflexion du module 2 :

- Pensez-vous que la psychothérapie assistée par l'IA peut remédier aux lacunes du système de soins de santé mentale ? Pourquoi ou pourquoi pas ?

- Quels sont les avantages et les inconvénients de la psychothérapie synchrone par rapport à la psychothérapie asynchrone ?

- Pensez-vous que l'IA remplacera les psychothérapeutes humains, pourquoi ou pourquoi pas ?

Travail de cours - Option 3 : Projet ou mémoire de fin d'études

Dans le cadre de cette mission, les étudiants sont chargés de développer un projet ou de rédiger un mémoire qui traite de l'utilisation de l'IA dans le domaine de la psychothérapie. Il s'agit notamment, mais pas exclusivement, de

- Développer une application de santé mentale spécifique aux étudiants du Cégep

- Développer une solution pour améliorer l'accès aux soins de santé mentale en utilisant l'IA pour, par exemple :

- diagnostiquer un trouble de la santé mentale

- réduire les temps d'attente pour un psychothérapeute

- rationaliser les traitements/interventions dans le domaine médical des patients

- Tester la précision, la fiabilité et la validité de l'IA pour détecter les maladies mentales à l'aide d'ensembles de données cliniques accessibles au public ou de données générées synthétiquement.

- Concevoir une expérience pour tester l'efficacité des psychothérapies assistées par l'IA

Liens vers les ensembles de données

Association américaine de psychologie. (2008). Liens vers des ensembles de données et des référentiels [Ensembles de données]. APA. https://www.apa.org/research/responsible/data-links

Harrigian, K. (2020). Mots clés de la santé mentale : Mots-clés et phrases qui peuvent être utilisés pour identifier les conversations liées à la santé mentale sur Twitter [Ensemble de données]. GitHub. https://github.com/kharrigian/mental-health-keywords

Harrigian, K. (2021). Ensembles de données sur la santé mentale : Une liste évolutive d'ensembles de données de médias électroniques utilisés pour modéliser l'état de santé mentale [Ensemble de données]. GitHub. https://github.com/kharrigian/mental-health-datasets

MOSTLY AI. (n.d.). Générer des données synthétiques. https://mostly.ai/synthetic-data-platform/generate-synthetic-data

Open Psychometrics Project (2019). Données brutes des tests de personnalité en ligne [Ensembles de données]. Open Psychometrics. https://openpsychometrics.org/_rawdata/

Substance Abuse & Mental Health Data Archive. (n.d.). Accueil. https://www.datafiles.samhsa.gov/

Références

Abd-Alrazaq, A. A., Alajlani, M., Ali, N., Denecke, K., Bewick, B. M. et House, M. (2021). Perceptions et opinions des patients sur les chatbots de santé mentale : Scoping review. Journal of Medical Internet Research, 23(1), e17828. 10.2196/17828

Aknin, L. B., De Neve, J.-E., Dunn, E. W., Fancourt, D. E., Goldberg, E., Helliwell, J. F., Jones, S. P., Karam, E., Layard, R., Lyubomirsky, S., Rzepa, A., Saxena, S., Thornton, E. M., VanderWeele, T. J., Whillans, A. V., Zaki, J., Karadag, O., & Ben Amor, Y. (2022). La santé mentale au cours de la première année de la pandémie de COVID-19 : A review and recommendations for moving forward. Perspectives on Psychological Science, 17(4), 915-936. 10.1177/17456916211029964

Amir, S., Dredze, M. et Ayers, J. W. (2019). Surveillance de la santé mentale sur les médias sociaux avec des cohortes numériques. In K. Niederhoffer, K. Hollingshead, P. Resnik, R. Resnik, & K. Loveys (Eds.), Actes du sixième atelier sur la linguistique computationnelle et la psychologie clinique : From Keyboard to Clinic (pp. 114-120). 10.18653/v1/W19-3013

Bram, B. (2022, 27 septembre). Opinion : Mon thérapeute, le robot : My year with WoeBot, an AI chat therapist. New York Times. https://www.nytimes.com/2022/09/27/opinion/chatbot-therapy-mental-health.html

Carlbring, P., Hadjistavropoulos, H., Kleiboer, A. et Andersson, G. (2023). Une nouvelle ère dans les interventions sur internet : The advent of Chat-GPT and AI-assisted therapist guidance. Internet Interventions, 32, 100621. 10.1016/j.invent.2023.100621

Chancellor, S. et Choudhury, M. D. (2020). Méthodes des techniques prédictives de l'état de santé mentale sur les médias sociaux : A critical review. NPJ Digital Medicine, 3(43). 10.1038/s41746-020-0233-7

Coheur, L. A. (2020). D'ELIZA à Siri et au-delà. In M.-J. Lesot, S. Vieira, M. Z. Reformat, J. P. Carvalho, A. Wilbik, B. Bouchon-Meunier, & R. R. Yager (Eds.), Communications in Computer and Information Science (CCIS) 1237, (pp. 29-41). 10.1007/978-3-030-50146-4_3

Darcy, A., Daniels, J., Salinger, D., Wicks, P. et Robinson, A. (2021). Evidence of human-level bonds established with a digital conversational agent : Cross-sectional, retrospective observational study. JMIR Formative Research, 5(5), e27868. 10.2196/27868

Harrigian, K., Aguirre, C. et Dredze, M. (2021). On the state of social media data for mental health research (L'état des données des médias sociaux pour la recherche en santé mentale). Dans N. Goharian, P. Resnik, A. Yates, M. Ireland, K. Niederhoffer, & R. Resnik (Eds.), Proceedings of the Seventh Workshop on Computational Linguistics and Clinical Psychology : Improving Access (pp. 15-24). 10.48550/arXiv.2011.05233

Jiang, Z., Zomick, J., Levitan, S. I., Serper, M. et Hirschberg, J. (2021). Automatic detection and prediction of psychiatric hospitalizations from social media posts. In N. Goharian, P. Resnik, A. Yates, M. Ireland, K. Niederhoffer, & R. Resnik (Eds.), Proceedings of the Seventh Workshop on Computational Linguistics and Clinical Psychology : Improving Access (pp. 116-121). 10.18653/v1/2021.clpsych-1.14

Johnson, S., Dalton-Locke, C., San Juan, N. V., Foye, U., Oram, S., Papamichail, A., Landau, S., Olive, R. R., Jeynes, T., Shah, P., Sheridan Rains, L., Lloyd-Evans, B., Carr, S., Killaspy, H., Gillard, S., Simpson, A., & The Covid-19 Mental Health Policy Research Unit Group. (2021). Impact on mental health care and on mental health service users of the COVID-19 pandemic : a mixed methods survey of UK mental health care staff. Social Psychiatry and Psychiatric Epidemiology, 56, 25-27. 10.1007/s00127-020-01927-4

Joshi, D. et Patwardhan, M. (2020). Une analyse de la santé mentale des utilisateurs de médias sociaux à l'aide d'une approche non supervisée. Computers in Human Behavior Reports, 2(100036), 1-9. 10.1016/j.chbr.2020.100036

Li, E., Midgley, N., Luyten, P. et Campbell, C. (2021). Therapeutic settings and beyond : A task analysis of re-establishing epistemic trust in psychotherapy. BMJ Open, 11(Suppl. 1), A8. 10.1136/bmjopen-2021-QHRN.21

Ma, L., Mor, S., Anderson, P. L., Baños, C., Bouchard, S., Cárdenas-López, G., Donker, T., Fernández-Álvarez, J., Lindner, P., Mühlberger, A., Powers, M. B., Quero, S., Rothbaum, B., Widerhold, B. K., & Carlbring, P. (2021). Intégration des réalités virtuelles et de la psychothérapie : SWOT analysis on VR and MR based treatments of anxiety and stress-related disorders. Cognitive Behaviour Therapy, 50(6), 509-526. 0.1080/16506073.2021.1939410

Moreno, C., Wykes, T., Galderisi, S., Nordentoft, M., Crossley, N., Jones, N., Cannon, M., Correll, C. U., Byrne, L., Carr, S., Chen, E. Y. H., Gorwood, P., Johnson, S., Kärkkäinen, H., Krystal, J. H., Lee, J., Lieberman, J., López-Jaramillo, C., Männikkö, M., Phillips, M. R., Uchida, H., Vieta, E., Vita, A., & Arango, C. (2020). How mental health care should change as a consequence of the COVID-19 pandemic (Comment les soins de santé mentale devraient changer suite à la pandémie de COVID-19). The Lancet : Psychiatry, 7(9), 813-824. 10.1016/S2215-0366(20)30307-2

Oppy, G. et Dowe, D. (2021). The Turing test. Dans E. L. Zlata (Ed.), The Stanford Encyclopedia of Philosophy (Winter 2021 edition). https://plato.stanford.edu/entries/turing-test/

Orr, M. P., van Kessel, K. et Parry, D. (2022). Le rôle éthique de la linguistique informatique dans la formulation psychologique numérique et la prévention du suicide. Dans A. Zirikly, D. Atzil-Slonim, M. Liakata, S. Bedrick, B. Desmet, M. Ireland, A. Lee, S. MacAvaney, M. Purver, R. Resnik, & A. Yates (Eds.), Proceedings of the Eighth Workshop on Computational Linguistics and Clinical Psychology (pp. 17-29). 10.18653/v1/2022.clpsych-1.2

Pedersen, C. B., Mors, O. et Bertelsen, A. (2014). Une étude nationale complète du taux d'incidence et du risque à vie pour les troubles mentaux traités. JAMA Psychiatry, 71(5), 573-581. 10.1001/jamapsychiatry.2014.16

Shashkevich, S. (2018, 17 octobre). La réalité virtuelle peut aider à rendre les gens plus compatissants par rapport à d'autres médias, selon une nouvelle étude de Stanford. Stanford News. https://news.stanford.edu/2018/10/17/virtual-reality-can-help-make-people-empathetic/

Singu, S. (2022). Analyse de la santé mentale pendant la pandémie de COVID-19. International Journal of Sustainable Development in Computing Science, 4(3), 41-50.

Uban, A. S., Chulvi, B. et Rosso, P. (2021). Comprendre les modèles de manifestations de l'anorexie dans les données des médias sociaux avec l'apprentissage profond. In N. Goharian, P. Resnik, A. Yates, M. Ireland, K. Niederhoffer, & R. Resnik (Eds.), Proceedings of the Seventh Workshop on Computational Linguistics and Clinical Psychology : Improving Access (pp. 224-236). 10.18653/v1/2021.clpsych-1.24

Wang, N., Luo, F., Shivtare, Y., Badal, V., Subbalakshmi, K. P., Chandramouli, R. et Lee, E. (2021). Learning models for suicide prediction from social media posts. In N. Goharian, P. Resnik, A. Yates, M. Ireland, K. Niederhoffer, & R. Resnik (Eds.), Proceedings of the Seventh Workshop on Computational Linguistics and Clinical Psychology : Improving Access (pp. 87-92). 10.18653/v1/2021.clpsych-1.9

Weizenbaum, J. (1966). ELIZA : un programme informatique pour l'étude de la communication en langue naturelle entre l'homme et la machine. Computational Linguistics, 9(1), 36-45.